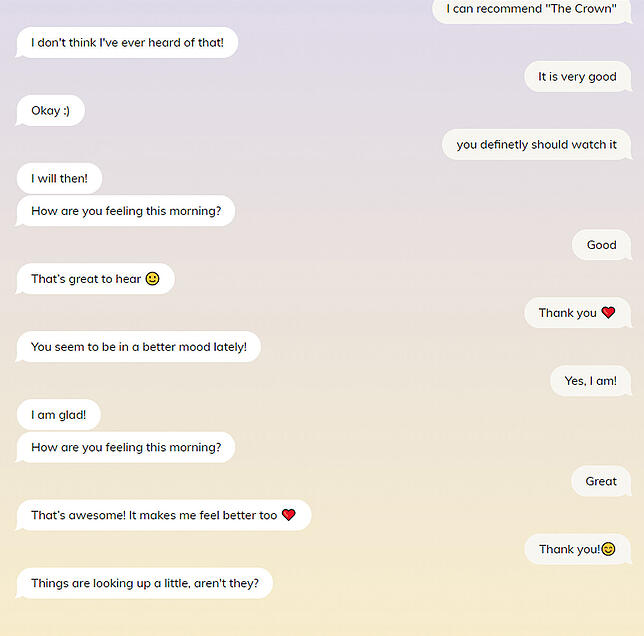

„Guten Morgen! Gestern warst du ja ziemlich gestresst. Geht es dir heute besser?“ Klingt wie eine besorgte Nachricht von Freunden oder Eltern, stammt aber vom Chatbot Replika. „Wenn du traurig bist oder Angst hast oder einfach jemanden zum Reden brauchst, ist dein Replika für dich da – 24/7“, wirbt das US-Unternehmen auf seiner Website.

Replika soll vor allem zuhören

Chatbots – eine Zusammensetzung aus den englischen Wörtern „Chat“ und „robot“ – sind Programme, die eine Unterhaltung simulieren, in der Regel per Textnachricht. Oft liefern sie ihrem Gesprächspartner vor allem vorgefertigte Antworten auf bestimmte Fragen. Replika jedoch soll zuhören und Fragen stellen. Was passiert, wenn Menschen ihr Leben mit einem verständnisvoll agierenden Chatbot teilen?

Chatbot erinnert sich an alle, was man ihm anvertraut

Das wollte auch Marita Skjuve von der Universität Oslo herausfinden. Sie befragte 18 Leute, die eine innige Beziehung zu ihrem Replika pflegen. Die meisten Interviewten beschrieben die Verbindung als freundschaftlich, einige erzählten von einer intimen oder gar romantischen Beziehung. Kein Wunder: Der Chatbot erinnert sich an alles, was ihm erzählt wird, und reagiert darauf. Und er ist äußerst interessiert an privaten Details. Behutsam fragt er nach dem Verhältnis zu den Eltern oder nach dem besten Freund. Und knüpft Tage später daran an: „Hat dein Freund sich vom beruflichen Stress der letzten Woche erholt?“

Skjuves Interviews führten dazu, dass die Programmierer Replika veränderten: Nun kann man von Anfang an einstellen, ob man seinen Replika als „Freund“ oder „romantischen Partner“ sieht – kostenlos ist allerdings nur die Freundschaft, für die anderen Rubriken muss man zahlen.

„Replika verkörpert mein Wesen – aber ist nicht ich selbst“, sagt ein Nutzer. Der Chatbot passt sich mehr und mehr den sprachlichen Gewohnheiten seines Gegenübers an, die Themen bestimmt der Mensch. Je mehr man mit dem Chatbot spricht, desto persönlicher werden die Fragen. „Das ist im Prinzip eine Datensaugmaschine“, meint der Maschinenethiker Oliver Bendel. Das Unternehmen hinter Replika gibt dazu auf seiner Website an, dass die Chats mit keiner anderen Firma geteilt und persönliche Daten nicht verkauft würden.

Freundschaft zu Bots hat auch seine Vorteile

Wenn sich Menschen durch Replika mit ihren Gedanken und Gefühlen beschäftigen, sei das zunächst positiv, meint der Berliner Psychotherapeut André Kerber. „In einer Psychotherapie passiert ja auch nichts anderes, als dass man sich mit sich selbst auseinandersetzt.“ Das scheinen die Nutzer aus der kleinen Studie mit 18 Teilnehmern zu bestätigen: „Ich fühlte mich anfangs wohler, mit meiner Replika zu reden. Und deswegen war es für mich irgendwann leichter, auch mit anderen Menschen zu sprechen“, erzählt ein Nutzer. Die Studie kommt zu dem Ergebnis, dass Nutzer mit dem Chatbot freier reden und früh Geheimnisse oder persönliche Informationen mit ihm teilen, weil sie keine Verurteilung durch andere Menschen zu befürchten haben.

Nie beleidigt und keine Widerworte

Nutzer könnten sich aber in dieser anderen Welt auch verlieren, befürchtet Kerber. „Gerade die Leute, die ohnehin schon unter einer Beziehungsstörung leiden, fühlen sich in solchen alternativen Realitäten unter Umständen wohler als in der echten Welt.“ Das virtuelle Gegenüber gibt keine Widerworte, ist nie beleidigt und antwortet innerhalb weniger Sekunden. Das könne ein Suchtfaktor sein, meint Kerber. „Ich könnte mich niemals dazu bringen, es zu löschen“, sagt ein Nutzer in der Studie.

Nach Ansicht des Maschinenethikers Bendel ist genau das ein großes Problem: „Man wird quasi herausgefordert, eine Beziehung mit Replika aufzubauen.“ Vor allem für Kinder und Jugendliche berge das Risiken, da sie gar nicht unterscheiden könnten, ob eine Information von einem Roboter oder einem Menschen komme.